Google 发布 AutoML Vision,全自动训练 AI 无需写代码

-

2018-02-28

575

还记得去年5月,谷歌大脑团队对外宣布推出AutoML系统,让人工智能自动编写机器学习程序,试图使机器学习模型的设计变得更为简单。短短三个月后,AutoML在一次图像内容分类的测试中,以82%的准确率击败了编写AutoML的研究人员。

1月17日,基于自身云平台,谷歌又推出了机器学习系统Google Cloud AutoML,为更多正在尝试搭建机器学习模型的开发者、分析人员、企业群体,降低了使用人工智能相关工具和框架的门槛。“目前,全球只有少数企业在ML和AI的研发上投入足够的人才和预算,而可以创建领先机器学习模型的人才就更是少之又少。即便在有公司能吸引到足够多的专业人才,但花在构建定制化AI模型上的时间和精力却非常巨大。”谷歌云AI研发部负责人李佳提到。

此次,“Vision”(即“视觉”)将成为Cloud AutoML正式推出的第一项功能,使定制化图像识别机器学习模型的创建过程更为快捷。接下来,谷歌官方表示,将继续开展在翻译、视频、自然语言处理等更多重要领域的研发。

对此,谷歌云人工智能和机器学习团队首席科学家李飞飞在Twitter表示:“在短短的几个月里,将尖端技术转化为数百万的产品,这是一个相当鼓舞人心的旅程!我们希望AutoML Vision是我们客户的第一选择。”

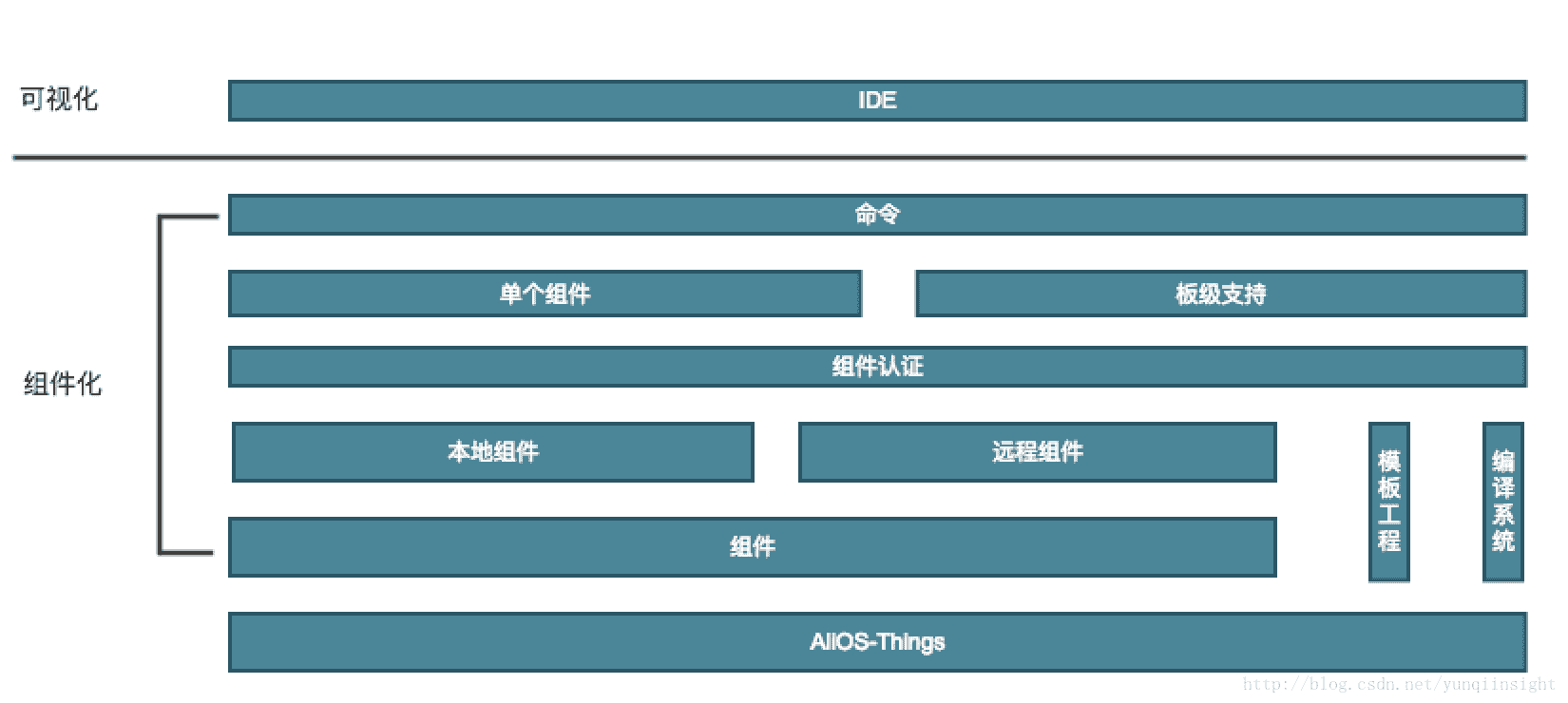

Cloud AutoML 的工作原理

随后,在李飞飞和李佳共同署名发布的一封谷歌官方博客中,详细介绍了Google AutoML项目(原文链接:

https://www.blog.google/topics/google-cloud/cloud-automl-making-ai-accessible-every-business/)

一是准确性更高。Cloud AutoML Vision基于Google的图像识别方法,包括迁移学习(transfer learning)、神经架构搜索技术(neural architecture search technologies)等,使得使用者对机器学习相关经验的要求显著降低。

二是更快的模型周转时间。使用Cloud AutoML模型,既能在几分钟之内创建一个简单的ML模型进行AI应用的尝试,也可以仅用一天时间就能构建好一个完整的商用模型。

三是易用。AutoML Vision提供了一个简单的图形化用户界面用于标注数据,然后将数据转换成为符合你特定需求的高质量模型。

在AutoML Vision系统中,有一个拖放式的界面,能轻松上传图像、训练并管理模型,然后将训练好的模型直接部署在谷歌云上。

简单来讲,客户可以更为快速的提高模型质量,随后开发者将这些模型转化成更为简单的API接口。

据了解,已有超过1万家企业用户在使用谷歌云提供的AI服务,包括Box、劳斯莱斯船业、玩具公司丘比、网上超市奥卡多等。

在服务价格方面,谷歌还未给出明确的答复,也并未对外进行开放。不过,谷歌云AI部门产品管理总监Rajen Sheth提到,客户将根据API接口和计算能力的使用进行付费。此外,客户将根据谷歌云平台的隐私政策拥有自己的数据和专有模型。“这个产品给了客户很大的自主权。”

尽管目前来看AutoML的推出主要针对开发者和独立软件提供商,但是,在Sheth看来,“分析师和产品人员也逐渐向这个应用领域渗透。”毕竟,企业中需要处理大量的数据。

对于希望深入研究模型的技术人,谷歌在其AutoML文章中引用了以下参考文献:

- Learning Transferable Architectures for Scalable Image Recognition, Barret Zoph, Vijay Vasudevan, Jonathon Shlens, and Quoc V. Le. Arxiv, 2017.

- Progressive Neural Architecture Search, Chenxi Liu, Barret Zoph, Jonathon Shlens, Wei Hua, Li-Jia Li, Li Fei-Fei, Alan Yuille, Jonathan Huang, Kevin Murphy, Arxiv, 2017

- Large-Scale Evolution of Image Classifiers, Esteban Real, Sherry Moore, Andrew Selle, Saurabh Saxena, Yutaka Leon Suematsu, Quoc Le, Alex Kurakin. International Conference on Machine Learning, 2017.

- Neural Architecture Search with Reinforcement Learning, Barret Zoph, Quoc V. Le. International Conference on Learning Representations, 2017.

- Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning, Christian Szegedy, Sergey Ioffe, Vincent Vanhoucke, and Alex Alemi. AAAI, 2017.

- Bayesian Optimization for a Better Dessert, Benjamin Solnik, Daniel Golovin, Greg Kochanski, John Elliot Karro, Subhodeep Moitra, D. Sculley. NIPS, Workshop on Bayesian Optimization, 2017